Cours Microprocesseur en PDF (Intermédiaire)

Introduction à l'architecture des microprocesseurs (niveau intermédiaire). Présentation structurée d'un système à microprocesseur et de ses jeux d'instructions : unité de contrôle, unités d'exécution, registres et interfaces. PDF pédagogique téléchargeable (26 pages) comprenant schémas fonctionnels, exemples en assembleur et pistes pour travaux pratiques.

Le microprocesseur coordonne le flux d'instructions, gère les registres et orchestre les accès mémoire pour traduire des programmes en opérations matérielles. Une bonne compréhension de l'architecture des ordinateurs permet d'optimiser le code, de choisir des architectures adaptées pour un projet embarqué et d'anticiper les effets de la hiérarchie mémoire sur les performances.

🎯 Objectifs d'apprentissage

- Unité de commande (UCC) et séquenceur — rôle du compteur ordinal (PC), registre d'instruction et décodeur ; distinction câblée vs micro-programmée et impact sur flexibilité et latence.

- Unité arithmétique et logique (UAL) et unités spécialisées — circuits d'addition, comparateurs, accumulateur, et unités FPU/multimédia (MMX, 3DNOW, SSE) : routage des instructions vers l'UAL ou la FPU et conséquences sur les performances numériques.

- Mémoire cache et contrôleur de cache — mécanismes L1/L2, algorithmes de remplacement, influence du hit rate et du contrôleur sur la latence d'accès ; compromis taille/temps pour optimiser l'exécution.

- Gestion de la mémoire : segmentation et pagination — traduction d'adresses logiques en adresses physiques, rôle des unités dédiées et impact sur protection et espace d'adressage (architectures x86 notamment).

- Registres essentiels du CPU — fonctions des registres généraux, pointeurs (PC, SP, SI, DI), registre d'adresse, accumulateur et PSW ; exemples d'usage en assembleur (ex.

ADD A,B). - Interface bus et unité d'anticipation (prefetch/queue) — fonctionnement de l'interface bus et du préfetcher, situations provoquant des stalls et rôle de la queue pour amortir les variations de latence I/O.

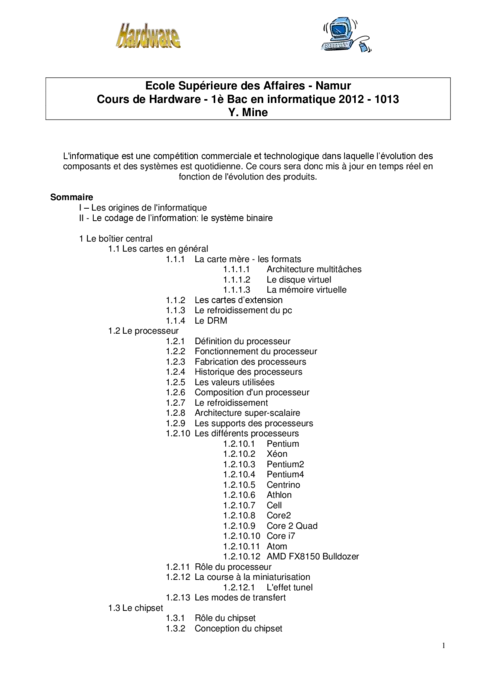

Historique et évolution des microprocesseurs

Jalons clés ayant structuré l'évolution des microprocesseurs, avec des repères techniques et chronologiques pour situer les architectures modernes.

- 1965 — formulation empirique de la loi de Moore, prédiction d'une croissance régulière du nombre de transistors.

- 1971 — Intel 4004 : premier microprocesseur commercial monolithique sur une puce, point de départ des systèmes à microprocesseur modernes.

- 1972 — Intel 8008 : passage à des jeux d'instructions 8 bits, fondamental pour les premiers terminaux et contrôleurs embarqués.

- 1974–1978 — familles logicielles et matérielles : Intel 8080 (1974) puis 8086 (1978), fondations des architectures x86.

- 1975 — Altair 8800 : popularisation de l'ordinateur personnel et diffusion des microprocesseurs dans les systèmes grand public.

- 1996–1999 — extensions SIMD : Intel MMX (1996), AMD 3DNow! (1998), Intel SSE (1999) pour accélérer le traitement multimédia.

- Années 2000 — passage massif au multicœur et à l'optimisation énergétique, évolution des microarchitectures vers des designs concurrentiels.

Concepts fondamentaux de l'architecture CPU

Distinction entre entité logique et implémentation matérielle : l'architecture décrit le jeu d'instructions et l'interface observable, tandis que l'architecture interne couvre l'organisation des pipelines, le dispatch, les hazards et la hiérarchie mémoire. Ce cadre facilite l'analyse des compromis performance/complexité lors de la conception ou de l'optimisation logicielle.

Architecture et jeux d'instructions

L'interaction entre architecture interne et jeux d'instructions conditionne l'efficacité d'exécution. Le jeu d'instructions définit les opérations et les formats, alors que la microarchitecture implémente leur exécution via pipelines, caches et unités spécialisées. Les premiers processeurs comme l'Intel 4004 proposaient un jeu d'instructions limité, ce qui simplifiait l'implémentation matérielle ; les designs ultérieurs ont élargi l'ISA et introduit des optimisations matérielles (out-of-order, spéculation) pour améliorer le débit. Comparer ISA et microarchitecture permet de comprendre pourquoi certaines instructions sont plus coûteuses et comment le compilateur ou le code assembleur peuvent compenser.

Exemples de Travaux Pratiques

Liste d'exercices types et pistes pratiques présentes dans le polycopié, destinées à expérimenter le système à microprocesseur et les jeux d'instructions via des simulations et du code assembleur.

- Simulation d'un pipeline simple : identification et résolution des hazards, mesure d'impact sur le nombre de cycles.

- Écriture et optimisation de routines en assembleur pour illustrer l'utilisation des registres et des instructions critiques.

- Expérimentation sur la hiérarchie mémoire : mise en place d'un bench pour mesurer l'effet du cache L1/L2 sur la latence et le throughput.

- Étude de la pagination et de la protection mémoire via exercices de traduction d'adresses et gestion de tables de pages.

- Analyse comparative : effets des extensions SIMD sur des algorithmes de traitement numérique.

💡 Pourquoi choisir ce cours ?

Polycopié de 26 pages rédigé par Malek Zribi, enseignant à l'ISET Sfax. Le document fournit des schémas techniques, des exemples d'assembleur et des pistes pour TP, favorisant une mise en pratique rapide pour les projets et travaux dirigés. La structure privilégie repères concrets sur registres, UAL, cache et gestion mémoire, utiles en conception embarquée.

👤 Public cible et prérequis

- Public cible : étudiants en électronique et informatique embarquée, techniciens hardware souhaitant consolider leurs connaissances sur l'interaction registre/unité/exécution.

- Prérequis : notions de logique numérique (portes, additionneur), représentation binaire et familiarité basique avec le langage assembleur.

- Travaux pratiques : exercices et exemples d'assembleur inclus pour servir de base à des TP et à un tutoriel pratique.

FAQ

Comment la hiérarchie cache L1/L2 influence-t-elle le throughput d'exécution ? Une L1 intégrée réduit la latence pour instructions et données critiques, augmentant le throughput lorsque le hit rate est élevé ; le contrôleur de cache et l'algorithme de remplacement déterminent la fréquence des accès à la mémoire principale et la variabilité des délais d'accès.

Quels avantages apporte un séquenceur micro-programmé par rapport à un séquenceur câblé ? Le microcode permet d'étendre ou de corriger l'ensemble d'instructions sans changer le circuit, au prix d'une surcharge en cycles. Une implémentation câblée offre généralement de meilleures performances par instruction mais moins de flexibilité pour des mises à jour ou extensions de jeu d'instructions.