Détection anomalies réseaux - Cours PDF (Avancé)

Support de cours Détection d’anomalies et sécurité des réseaux : Ce qu'il faut savoir. Discipline qui regroupe les méthodes statistiques, probabilistes et procédurales permettant d'identifier des activités réseau déviantes ou malveillantes par rapport à un comportement attendu. L'enjeu opérationnel est de réduire le temps de détection et d'atténuer les trajectoires d'attaque (Cyber Kill Chain) tout en priorisant les ressources selon la criticité des actifs.

🎯 Ce que vous allez apprendre

- Diagnostic et prévention (EBIOS Risk Manager, CKC) — Comprendre l'usage d'EBIOS Risk Manager pour cartographier les risques et appliquer la Cyber Kill Chain (CKC) afin d'identifier les étapes d'une intrusion. Priorisation des mesures de prévention et lien entre scénarios d'attaque et chemins vulnérables identifiés par des scores CVSS.

- Collecte et traitement des journaux d'événements — Maîtriser la collecte, la structuration et la fenêtre temporelle d'analyse des logs et flux réseau pour produire des séries temporelles exploitables. Formats, métriques (paquets, octets, ports, protocoles) et procédures d'agrégation pour alimenter des détecteurs statistiques et ML.

- Construction de la base Data ISO‑MA — Méthodologie de construction d'une base d'actifs (Data ISO‑MA), extraction d'attributs et calcul de pertinence pour chaque actif support, afin de créer des jeux de données réalistes pour l'évaluation des détecteurs.

- Détection de chemins vulnérables et scénarios stratégiques — Formalisation d'un chemin vulnérable, évaluation de la force d'un attaquant et identification de la CKC la plus critique pour un objectif donné, appuyées par résultats expérimentaux.

- Modèles de Markov et GLRT pour la détection — Modélisation des flux par chaînes de Markov, estimation paramétrique des états et utilisation du GLRT (Generalized Likelihood Ratio Test) pour le test d'hypothèses. Calibration de seuil (p-value r0) et comparaison de modèles sur données synthétiques et réelles.

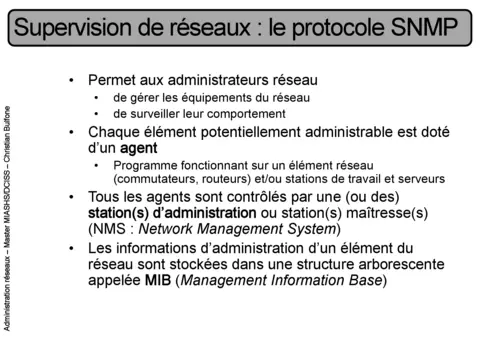

Intégration dans un Système de Détection d'Intrusion (IDS)

La détection d'écarts comportementaux alimente un IDS en fournissant des alertes issues de modèles statistiques ou comportementaux. En exploitation, les modules d'anomalie complètent les règles signatures et assurent une surveillance continue, l'analyse d'événements et la corrélation entre sources de logs. L'intégration opérationnelle implique des formats de logs normalisés, des règles de validation manuelle et des boucles de rétroaction pour réduire les faux positifs tout en maintenant la sensibilité aux attaques émergentes. Une stratégie efficace combine filtrage de flux, agrégation locale et processus de triage dans le SOC.

Méthodes d'apprentissage non supervisé pour la sécurité

Les approches non supervisées exploitent la structure intrinsèque des données afin de détecter des incidents sans étiquettes. Méthodes courantes : modèles markoviens pour la dynamique temporelle, tests de vraisemblance (GLRT) pour comparer des hypothèses, clustering pour regrouper comportements normaux et réduction de dimension pour filtrer les flux. Les modèles apprennent des motifs normaux — transitions d'états, profils de trafic ou signatures temporelles — et signalent des écarts significatifs. L'interprétabilité est essentielle : associer une anomalie détectée à une séquence d'événements facilite le triage et la réponse. Pour les environnements distribués, privilégier l'agrégation locale, le recalibrage périodique et des indicateurs robustes aux variations saisonnières des séries temporelles.

Automatisation de la surveillance réseau

Automatiser la détection permet de réduire le délai entre l'apparition d'un écart et la prise de décision opérationnelle. Les modèles de Markov, une fois entraînés sur des fenêtres temporelles représentatives, peuvent générer des scores de discordance en continu et déclencher des alertes automatisées selon des règles de confiance et de priorisation. L'automatisation inclut pipelines de prétraitement des logs, seuils adaptatifs basés sur l'historique, et mécanismes de feedback pour recalibrer périodiquement les modèles. Dans ce cadre, l'orchestration limite l'intervention humaine aux cas nécessitant enrichissement contextuel ou validation manuelle, améliorant ainsi la capacité du SOC à traiter les incidents à grande échelle.

Comparaison : Apprentissage supervisé vs non supervisé

Rappel des objectifs et compromis pour la détection d'intrusions afin d'orienter le choix méthodologique selon disponibilité d'étiquettes, coûts d'annotation et contraintes opérationnelles.

| Approche | Avantages | Inconvénients |

|---|---|---|

| Supervisée | Précision élevée sur classes connues, métriques d'évaluation directes, bonnes performances pour tâches de classification. | Nécessite jeux étiquetés coûteux; faible détection des nouveaux types d'attaque non vus pendant l'entraînement. |

| Non supervisée | Détection d'écarts sans étiquettes, adaptée aux flux évolutifs et aux environnements inconnus; utile pour anomalies zero‑day. | Interprétabilité et calibrage des seuils exigent expertise; taux de faux positifs potentiellement plus élevé sans post‑traitement. |

📑 Sommaire du cours PDF : Détection d’anomalies

Applications à la surveillance des réseaux critiques

Les méthodes présentées s'appliquent aux environnements de supervision des réseaux d'entreprise et des infrastructures critiques où la surveillance des réseaux exige résilience et explicabilité. Les modèles markoviens et le GLRT permettent d'identifier des ruptures dans la distribution des flux and d'alerter des opérateurs avant propagation d'une compromission. Les déploiements distribués requièrent réduction de dimension, agrégation locale des métriques et stratégies de calibration répartie pour tenir compte des contraintes de bande passante et de calcul.

Sécurité des réseaux IoT et systèmes distribués

Pour les systèmes IoT distribués, l'approche doit intégrer contraintes de latence et ressources limitées : filtrage de flux sur nœud, agrégation hiérarchique et recalibrage périodique des modèles. Les architectures edge‑to‑cloud favorisent l'exécution de détecteurs légers localement et l'analyse agrégée en back‑end pour déduire patterns à plus grande échelle tout en préservant bande passante et confidentialité.

Informations sur le fichier

- Format : PDF

- Pages : 179

- Taille : 1.52 Mo

- Auteur : Mamadou Kasse — manuscrit soutenu en thèse et disponible sur HAL

❓ Foire Aux Questions (FAQ)

Comment la GLRT est‑elle utilisée pour détecter une anomalie sur des séries de flux ?

La GLRT compare la vraisemblance des observations sous l'hypothèse nulle (comportement normal) et l'hypothèse alternative (anomalie) en estimant les paramètres via maximum de vraisemblance. Le ratio obtenu est comparé à un seuil calibré (p‑value r0) pour déclencher une alerte. L'approche intègre l'incertitude liée à l'estimation des paramètres du modèle de Markov et convient aux scénarios où les écarts modifient la dynamique de transition entre états.

Comment sont estimés et utilisés les modèles de Markov dans ce document ?

Les chaînes de Markov sont définies par un espace d'états reflétant les zones comportementales des flux; les paramètres de transition sont estimés par fréquence empirique on fenêtres temporelles. Une fois entraînés, ces modèles servent à prédire la distribution normale des métriques et à détecter les écarts via des tests d'hypothèses et des comparaisons de modèles (par exemple 2 états vs 3 états). L'approche convient aux contextes où les étiquettes d'anomalie font défaut.