Cours PDF Programmation : Maîtriser l'Algorithmique (Intermédiaire)

Pourquoi télécharger ce cours d'algorithmique ?

Téléchargez un support PDF structuré pour approfondir les structures de données, la complexité et les techniques d'implémentation. Le document propose des explications conceptuelles, exemples transposables en Java/C++/Python et des exercices algorithmique corrigés pdf pour s'entraîner efficacement. Auteur(s) : Jean Berstel et Jean‑Éric Pin.

🎯 Ce que vous allez apprendre

- Types de données et références : représentation des types, lien avec la mémoire et comportement des références.

- Structures de contrôle : conditions et itérations (if, switch, for, while) pour exprimer les algorithmes impératifs.

- Programmation impérative : concepts de base (assignation, contrôle de flux, effets de bord) et style impératif.

- Méthodes, sous-programmes et variables statiques : structuration en sous-programmes, gestion des variables statiques et points de liaison avec la compilation.

- Listes chaînées : définitions, opérations courantes et complexité des algorithmes associés.

- Structures de données séquentielles et hachage : tableaux, listes, piles, files et tables de hachage; implémentations et usages.

- Gestion des partitions (

Union-Find) : algorithme, optimisation et applications. - Arbres binaires : parcours, insertion/recherche et structures de recherche.

Algorithmique impérative et structures de contrôle

Les constructions conditionnelles et les itérations forment le socle de la programmation impérative. Les modèles de contrôle (if/switch, boucles for/while) sont présentés avec des invariants, des stratégies de terminaison et des motifs d'usage permettant d'écrire des algorithmes corrects et efficaces. Des exemples d'implémentation et des exercices corrigés relient formalisation théorique et pratique d'implémentation.

Structures de contrôle et itérations

Focus sur les expressions booléennes, l'ordonnancement des tests et l'optimisation des boucles. La maîtrise des itérations permet d'analyser la complexité pratique des algorithmes et d'identifier les transformations itératives/ récursives adaptées au problème.

Concepts clés de la programmation impérative

Cette section synthétise les notions indispensables : contrôle de flux, gestion des effets de bord, mécanismes de passage de paramètres et rôle des conventions d'appel. Elle situe également les choix d'implémentation (par exemple, passage par valeur vs référence) par rapport aux contraintes mémoire et de performance.

Programmation impérative

La programmation impérative met l'accent sur la modification explicite de l'état via affectations et structures de contrôle. Le cours compare styles impératif et déclaratif pour montrer quand préférer un paradigme à l'autre, et illustre les impacts sur la testabilité et la complexité des algorithmes.

Sous-programmes et compilation

Les sous-programmes organisent le code en unités réutilisables : procédures, fonctions et méthodes. Le document explique les étapes de la compilation qui affectent leur comportement : conventions d'appel, allocation des paramètres, liaison des symboles et optimisation (inlining, élimination de code mort). La gestion des variables statiques et la visibilité binaire sont détaillées pour comprendre comment la compilation influence la performance au moment de l'exécution.

Maîtriser les structures de données et la complexité

Le texte lie types de données et gestion mémoire : représentation des valeurs, pointeurs/références et impact sur les performances (accès, copie, allocation). La distinction entre types primitifs (stockés par valeur) et objets/références (allocation dynamique) est explicitée pour estimer les coûts de copie et d'accès. L'analyse compare différentes implémentations (séquentielle vs hachage) en termes d'insertion, suppression et recherche.

La représentation binaire en mémoire montre comment l'alignement, l'endianness et les formats de stockage influent sur la taille effective des structures et sur le coût des copies et accès, en particulier pour des implémentations bas‑niveau proches du langage C. La relation entre types de données et architecture machine est explicitée : taille des mots CPU, taille des pointeurs, coût d'indirection, effet des lignes de cache et contraintes d'alignement expliquent des écarts pratiques entre complexité théorique et performance réelle.

Méthodes, sous-programmes et variables statiques : présentation des mécanismes d'appel, de la portée et de la durée de vie des variables. Le rôle du compilateur dans la génération de code, la liaison des symboles et l'allocation des variables statiques est abordé pour éclairer les choix d'optimisation et les effets sur la visibilité au niveau binaire.

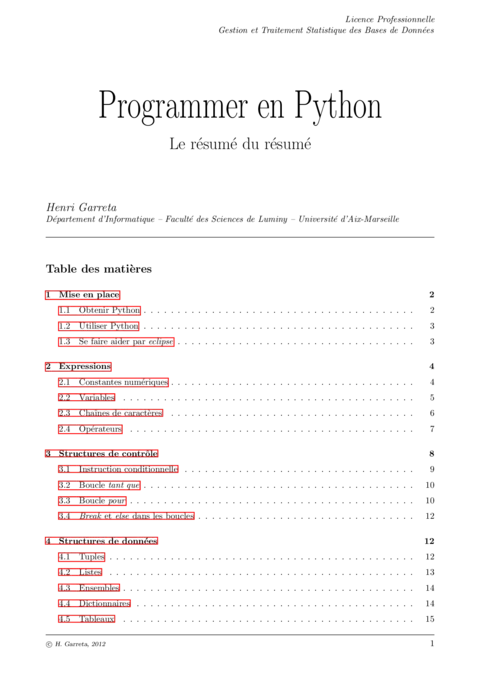

📑 Sommaire du document

- Compléments de programmation

- Structures séquentielles

- Piles et files

- Arbres

Applications concrètes de l'algorithmique

Huffman(codage) et variantes pour la compression.- Problèmes de simulation et recherche spatiale (ex : problème des N corps).

- Arbres binaires de recherche et applications de recherche rapide.

Algorithmes avancés : Huffman et recherche spatiale

Exemples d'algorithmes avancés tels que le codage de Huffman pour la compression et des problématiques de recherche spatiale et de simulation (par exemple le problème des N corps) illustrent l'application des structures étudiées. Chaque cas met l'accent sur le compromis entre complexité temporelle et coût mémoire, ainsi que sur les choix d'implémentation (hachage, arbres) pertinents selon le contexte.

Public cible et Prérequis techniques

Prérequis techniques : notions de programmation impérative (variables, boucles, fonctions), compréhension élémentaire des types de données et de leur représentation en mémoire, notions de complexité algorithmique. Public visé : étudiants et développeurs souhaitant approfondir la conception et l'analyse de structures de données et d'algorithmes.

- Maîtrise des boucles (for, while) et des conditions.

- Maîtrise de l'écriture et de l'appel de fonctions/procédures.

- Compréhension élémentaire des types de données et des opérations sur tableaux.

Langages et Pseudo-code

Les concepts sont illustrés principalement en pseudo‑code, lisible et indépendant d'un langage particulier. Les algorithmes présentés sont transposables en code source Java, C++ ou Python avec peu d'adaptations, et les exemples signalent les points d'attention liés au typage et à la gestion mémoire propres à chaque langage.

Analyse de la complexité et notation Grand O

Une section dédiée compare les complexités temporelles et spatiales des structures et algorithmes étudiés en insistant sur la complexité asymptotique. Les métriques standard (notations asymptotiques, cas moyen/pire) servent à évaluer les compromis théoriques, tandis que des exemples montrent comment la complexité spatiale et les constantes cachées varient selon le choix d'implémentation.

Notation Grand O et Complexité

La notation Grand O exprime la croissance asymptotique d'une fonction de coût en fonction de la taille de l'entrée. Des exemples traduisent des récurrences en bornes asymptotiques et expliquent l'interprétation pratique des cas moyen et pire. L'analyse met en relation complexité asymptotique et contraintes mémoire pour favoriser des choix d'implémentation adaptés aux besoins réels.

Exercices corrigés d'algorithmique et TD (PDF)

Codage de Huffman pas à pas

Construction de l'arbre, codage/décodage et solutions commentées pour comprendre l'algorithmique et les choix d'implémentation.

Équilibrage d'arbres AVL

Insertion, rotations et preuve d'invariants avec corrigé détaillé pour maîtriser les propriétés d'équilibre.

Optimisation d'un Union-Find

Techniques union by rank et path compression avec mesures empiriques et corrections explicites.

Implémentation d'une table de hachage robuste

Résolution des collisions, choix d'algorithmes de hash et solutions détaillées pour une table de hachage performante.

Chaque exercice inclut des indications méthodologiques et des objectifs d'évaluation pour guider l'apprentissage pratique.