Cours Les avancées de l'intelligence artificielle (Avancé)

Vous cherchez à télécharger un cours PDF sur les avancées de l'intelligence artificielle ? Ce document de 160 pages offre une expertise technique approfondie pour les profils avancés.

Les avancées de l’intelligence artificielle : Une analyse stratégique des fondations de l'IA. L'ouvrage compile une analyse technique et stratégique des progrès récents en IA, depuis les moteurs de règles et les SVM jusqu'au deep learning et à la robotisation, en s'appuyant sur études de cas et cartographies sectorielles. Ce panorama explique pourquoi ces briques (réseaux de neurones, reconnaissance d'images et de la parole, architectures matérielles GPU/TPU) transforment des secteurs entiers et comment lire les annonces marketing des acteurs.

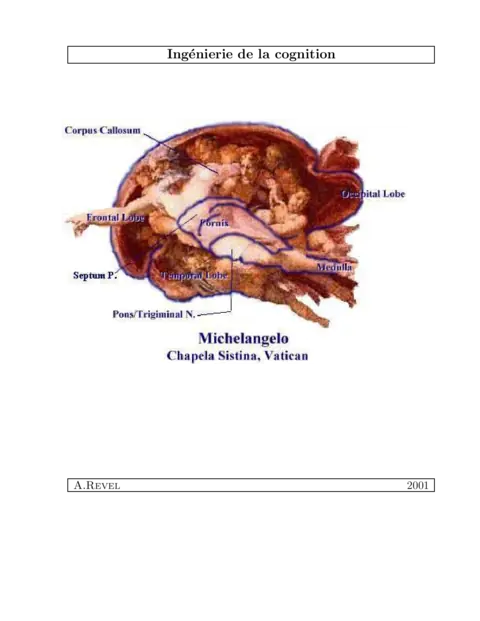

Note historique : Ce document constitue une archive précieuse de l'état de l'art de l'IA en 2016, offrant une perspective unique sur les prédictions technologiques de l'époque.

🎯 Ce que vous apprendrez

- Définition des agents intelligents

- Logique vs Apprentissage statistique

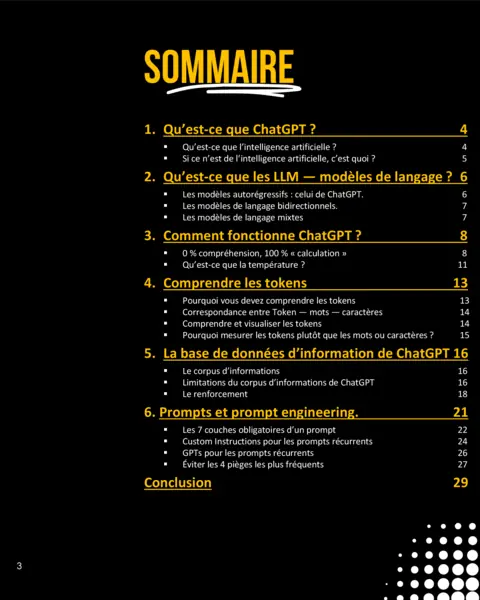

- Segmentation et définitions de l'IA — Distinction rigoureuse entre IA faible/forte, systèmes experts et agents intelligents, avec justification des usages opérationnels pour chaque classe d'algorithmes. Vous pourrez classer une application selon sa logique (moteur de règles vs apprentissage statistique) et choisir l'approche adaptée pour un cas métier précis.

- Algorithmes et méthodes : SVM, réseaux de neurones et deep learning — Propriétés techniques des Support Vector Machines, des réseaux convolutionnels et des architectures profondes, leurs forces et limites face au surapprentissage et à la dépendance aux données étiquetées. Explications sur le choix d'un CNN pour la vision et l'évaluation du compromis biais/variance.

- Cas pratique : IBM Watson et études sectorielles — Analyse critique de la victoire de Watson au Jeopardy, de son positionnement marketing et des applications en santé et entreprise, appuyée par études de cas extraites du document. Niveaux d'intégration nécessaires pour industrialiser une solution cognitive et pièges classiques du transfert vers l'exploitation.

- Infrastructures et loi de Moore — Impacts de l'évolution de la puissance de calcul, du stockage et des capteurs sur la faisabilité des modèles en production, y compris usage de GPU/TPU et contraintes énergétiques. Méthodes pour anticiper les besoins hardware et stratégies d'optimisation (quantification, pruning).

- Écosystème des startups et stratégie industrielle — Cartographies de startups, revues d'acquisitions et modèles d'innovation autour des plateformes IA. Outils pour identifier opportunités de partenariat, leviers de différenciation produit et scénarios d'acquisition.

- Robotisation et impacts métiers — Synthèse sur la robotisation des professions, limites des prédictions d'emploi et conseils pratiques pour se repositionner face à l'automatisation. Construction d'un plan d'adaptation métier intégrant reconnaissance d'images, NLP et automates logiciels.

Concepts fondamentaux abordés

Pour interpréter les annonces et publications liées à l'IA, privilégiez l'examen des jeux de données, des protocoles d'évaluation et des comparaisons aux bases de référence. Vérifiez la reproductibilité (code, métriques détaillées), la taille et la diversité des jeux d'entraînement, ainsi que les coûts computationnels et énergétiques associés à l'entraînement et à l'inférence. Ce guide propose des critères pratiques pour juger des revendications techniques et rappelle les fondamentaux nécessaires pour évaluer robustesse et généralisabilité.

L'IA en 2016 : Une rétrospective stratégique

Le document offre un état des lieux de 2016 utile pour comprendre les transitions technologiques ultérieures. Il replace les choix d'architecture, les compromis algorithmique/hardware et les modèles économiques dans leur contexte temporel, ce qui facilite l'évaluation des hypothèses aujourd'hui. Cette rétrospective aide à distinguer innovations durables et tendances passagères, et sert de base pour la consultation de textes sur les fondamentaux destinés à la formation et à la stratégie.

Vers l'IA moderne

Les concepts exposés en 2016 ont évolué vers des architectures à grande échelle, notamment les modèles de type transformer et les grands modèles de langage (LLM). Les fondements présentés — optimisation, architecture réseau, contraintes hardware — restent pertinents pour comprendre cette évolution et pour mettre en perspective choix méthodologiques et limites actuelles.

Guide de démarrage rapide

1) Lire la synthèse initiale pour repérer les sections pertinentes : commencez par les chapitres sur architectures et infrastructures (GPU/TPU) afin d'évaluer les implications opérationnelles pour votre projet. 2) Tester les exemples et études de cas : reproduisez les protocoles décrits (jeux de données, métriques) pour valider les conclusions sur un jeu local ou un échantillon représentatif. 3) Adapter aux contraintes métier : utilisez les fiches pratiques sur quantification, pruning et dimensionnement hardware pour estimer coûts et latences avant déploiement. Ces trois étapes permettent d'exploiter efficacement le PDF comme tutoriel technique et support opérationnel.

Pourquoi ce cours PDF est une référence en IA

La synthèse d'Olivier Ezratty combine veille industrielle, analyses algorithmiques et retours de terrain, offrant une lecture utile pour décideurs et ingénieurs. Le texte juxtapose descriptions techniques (SVM, CNN, méthodes statistiques) et cas pratiques (IBM Watson, cartographies de startups) pour faciliter la traduction de la théorie en implémentation opérationnelle. Pour accéder directement aux notions de base, consultez la partie dédiée aux Fondamentaux du Machine Learning. Ce document sert également de support de cours IA et peut être utilisé comme tutoriel intelligence artificielle avancé ou comme point de départ pour télécharger cours IA PDF destinés à l'approfondissement.

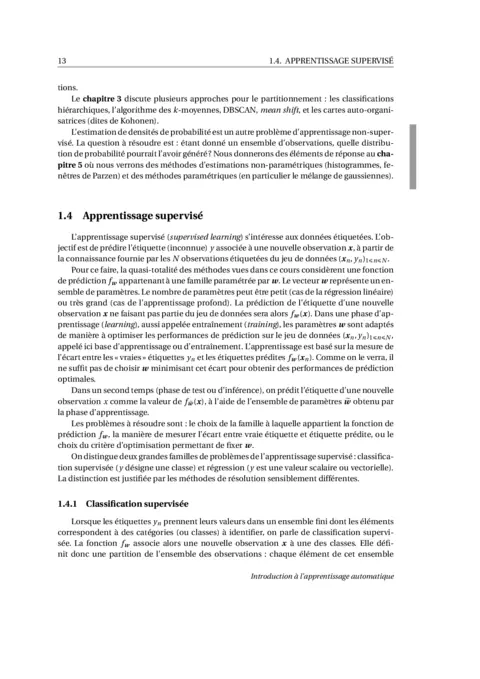

Fondamentaux du Machine Learning

Cette sous-section couvre les principes essentiels du machine learning : apprentissage supervisé et non supervisé, validation croisée, métriques pertinentes (précision, rappel, F1), enjeux de biais et variance, importance de la qualité des features et stratégies de régularisation. Sont également abordées les bonnes pratiques d'évaluation reproductible (train/validation/test, baselines), la gestion des jeux de données déséquilibrés et les techniques de réduction de dimension. Ce module peut servir de support de cours IA pour renforcer les acquis théoriques avant l'expérimentation pratique décrite dans le tutoriel intelligence artificielle avancé du document.

💡 Pourquoi consulter cette archive sur l'IA ?

La synthèse combine veille industrielle, analyses algorithmiques et retours de terrain, offrant une lecture utile pour décideurs et ingénieurs. Le format modulaire permet une consultation ciblée selon besoins techniques ou stratégiques et met l'accent sur l'analyse critique des annonces marketing et des preuves techniques fournies.

À propos de l'auteur : Rédigé par Olivier Ezratty, analyste et consultant en technologies numériques, le texte s'appuie sur une pratique de la veille technologique et de l'analyse sectorielle.

👤 À qui s'adresse ce cours ?

- Public cible : ingénieurs en machine learning, data scientists, chefs de produit et décideurs technologiques souhaitant comprendre l'impact concret des architectures IA, des startups aux grands acteurs.

- Prérequis : notions en apprentissage automatique (algèbre linéaire, probabilités), familiarité avec concepts de réseaux de neurones et expérience pratique en programmation ou utilisation d'outils ML.

❓ Foire Aux Questions (FAQ)

Quelles différences opérationnelles entre SVM et réseaux de neurones profonds pour la reconnaissance d'images ? Les SVM restent pertinents sur des jeux de petite taille et des représentations pré-calculées, car ils contrôlent bien la marge et réduisent l'overfitting sans millions d'exemples. Les réseaux convolutionnels apprennent des représentations hiérarchiques depuis les pixels et surpassent les SVM à grande échelle, mais requièrent accélérateurs et stratégies de régularisation (dropout, data augmentation).

Comment l'évolution de la loi de Moore influe-t-elle sur le déploiement des modèles deep learning ? Le ralentissement de la loi de Moore incite à optimiser le logiciel (quantification, pruning, distillation) et à recourir à accélérateurs spécialisés (TPU, ASIC) pour maîtriser coûts énergétiques et latences. La fiche analyse aussi les implications stockage/capteurs et fournit des repères pour dimensionner l'infrastructure selon entraînement ou inférence en production.