Cours Intelligence artificielle en PDF (Avancé)

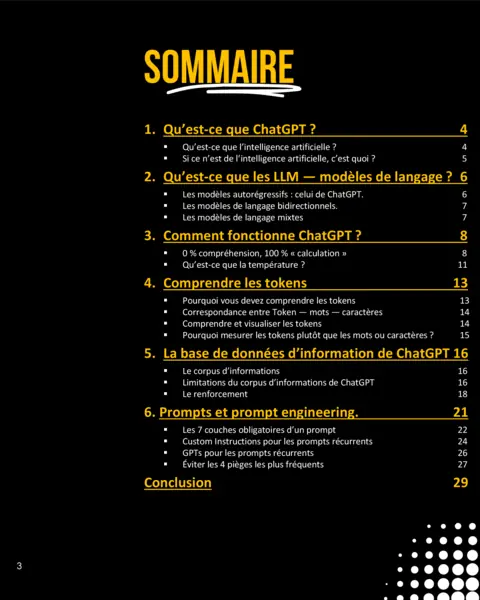

Cours d'intelligence artificielle : éléments essentiels pour un niveau avancé. L'intelligence artificielle regroupe des méthodes symboliques et connexionnistes visant à modéliser, raisonner et apprendre à partir de données et d'interactions. Ce document couvre les fondements théoriques (logiques formelles, recherche d'états) et les approches numériques (réseaux de neurones, apprentissage par renforcement), utiles en contexte industriel et recherche. Le support propose algorithmes, exemples et études de cas, avec une méthodologie rigoureuse et des protocoles reproductibles pour les expérimentations. Cliquez sur le bouton de téléchargement pour obtenir le support complet de 100 pages au format PDF.

Histoire et évolution de l'IA

La trajectoire de l'IA croise plusieurs vagues : la logique formelle et les systèmes experts des années 1950–1980, suivies par le renouveau connexionniste et l'essor des réseaux de neurones à partir des années 1980–1990, puis la montée du deep learning et des architectures par attention au XXIᵉ siècle. Cette évolution éclaire les choix méthodologiques contemporains et explique la coexistence d'approches symboliques et statistiques. Une compréhension de l'histoire de l'IA aide à contextualiser les méthodes, leurs forces et leurs limites, et oriente la sélection d'algorithmes adaptés aux cas d'usage.

Genèse de l'IA : de Turing aux réseaux de neurones

Les travaux fondateurs d'Alan Turing et la formalisation des machines et de l'intelligence ont jeté les bases théoriques. Dès les premières expériences sur les réseaux de neurones formels, la communauté a alterné entre approches symboliques (raisonnement explicite) et connexionnistes (apprentissage statistique). Les avancées en calcul distribué, en méthodes d'optimisation et en disponibilité de données massives ont permis la résurgence des modèles profonds. Comprendre cette genèse facilite l'interprétation des modèles modernes et l'intégration d'éléments symboliques pour améliorer vérifiabilité et explicabilité.

Prérequis recommandés

Connaissances et compétences conseillées pour tirer pleinement parti du support :

- Algèbre linéaire (espaces vectoriels, matrices, décompositions)

- Probabilités (variables aléatoires, distributions, estimation)

- Maîtrise de Python ou Lisp pour implémenter et reproduire les exemples

🎯 Ce que vous allez apprendre

-

Recherche d'états et algorithmes de graphe

Parcours en largeur/profondeur, A* et heuristiques admissibles ; formulation d'un problème comme graphe d'états et choix de stratégies pour réduire le coût en temps et en mémoire.

-

Algorithmes de jeu et élagage

Minimax, NEGMAX et Alpha‑Beta : complexité, stratégies d'ordre des coups et techniques d'élagage pour accélérer les décisions adversariales.

-

Systèmes experts et représentation des connaissances

Conception d'une base de règles, gestion des conflits et explicabilité des décisions dans des systèmes de diagnostic ou d'aide à la décision.

-

Logiques formelles et méthodes de résolution

Logique des propositions, calcul des prédicats, méthodes d'Herbrand et unification ; utilisation de la résolution automatique pour prouver des propriétés.

-

Réseaux de neurones et apprentissage supervisé

Perceptron, rétropropagation, analyse de convergence via le gradient stochastique et le LMS ; bases essentielles à l'apprentissage profond.

-

Apprentissage par renforcement et architectures multi‑agents

TD(λ), Q‑learning, Dyna‑Q et principes de conception des SMA ; modélisation d'agents apprenants et intégration pour intelligence collective.

Sommaire détaillé du cours PDF

- Introduction

- Recherche dans un espace d'états

- Systèmes experts

- Logiques formelles

- Logique floue

- Réseaux de neurones supervisés

- Réseaux de neurones non-supervisés

- Renforcement

💡 Pourquoi choisir ce cours ?

Le support d'A.Revel combine fondements historiques, formalisation mathématique et implémentations concrètes (algorithmes, études de cas). Méthodologie pédagogique axée sur preuves et reproductibilité : définitions formelles, algorithmes commentés et traces expérimentales permettant d'évaluer performance et limites. Exercices et études de cas inclus. Convient pour travaux pratiques, projets de recherche et préparation aux évaluations académiques.

Comparaison : IA Symbolique vs IA Connexionniste

La tradition symbolique privilégie la représentation explicite des connaissances et le raisonnement logique, utile pour la vérifiabilité et l'explicabilité. L'approche connexionniste repose sur l'apprentissage statistique à partir de données, apportant robustesse face au bruit. Les réseaux étudiés offrent la base conceptuelle des méthodes modernes, qui combinent souvent règles symboliques et modèles neuronaux pour bénéficier à la fois du contrôle et de la généralisation.

Limites, perspectives et IA générative

Les LLM excellent en génération et généralisation statistique mais présentent des limites en explicabilité et garanties formelles. L'hybridation (règles + réseaux) et l'usage de Transformers pour enrichir des systèmes capables d'expliquer des décisions constituent des pistes prometteuses. Les fondations connexionnistes — propagation du gradient, architectures récurrentes et représentations distribuées — ont préparé la voie aux architectures par attention, qui favorisent le parallélisme et la modélisation contextuelle dans des tâches de génération et de raisonnement approximatif.

Les Transformers reposent sur le mécanisme d'attention auto‑pondérée plutôt que sur des étapes récurrentes : chaque position de séquence pondère dynamiquement les autres positions via clé‑requête‑valeur (key/query/value). Cette architecture permet de modéliser des dépendances longues sans recourir à la récursivité, améliore le parallélisme et facilite l'entraînement sur grands corpus. Par rapport aux réseaux classiques, l'attention réduit la dépendance au passage séquentiel et offre une meilleure capacité à contextualiser les représentations, utile pour les LLM et les tâches d'IA générative.

Applications modernes des algorithmes de recherche

Recherche et heuristiques demeurent centrales en planification robotique, optimisation combinatoire et jeux. A* et variantes réduisent l'espace de recherche ; l'intégration d'algorithmes stochastiques étend l'applicabilité aux environnements incertains et partiellement observables.

- Diagnostic médical : aide à l'interprétation de données et détection d'anomalies, par exemple détection de nodules pulmonaires sur radiographies, segmentation de lésions tumorales sur IRM et classification de dermatoses à partir d'images cliniques.

- Extraction d'informations cliniques : NLP pour structurer les comptes rendus et identifier signes cliniques pertinents.

- Maintenance prédictive : détection précoce de dégradations via modèles temporels.

- Optimisation logistique : planification de tournées et allocation de ressources.

📑 Mise en route : installation d'un environnement de test

Exemples pour reproduire les expérimentations : environnement Python pour apprentissage profond et environnement Lisp pour méthodes symboliques. Activez l'environnement virtuel et installez les bibliothèques recommandées pour expérimenter et profiler les algorithmes.

# Python : création d'un environnement virtuel et installation minimale

python3 -m venv ia-venv

source ia-venv/bin/activate

pip install numpy scipy scikit-learn torch tensorflow jupyter

# Lisp (SBCL) : installation et démarrage REPL

# (sur Debian/Ubuntu)

sudo apt-get install sbcl slime

sbclUtilisation des scripts fournis pour tester A* et Alpha‑Beta : placez les fichiers fournis dans le répertoire de travail, activez l'environnement Python, puis lancez le script dédié à A* pour évaluer des cartes ou des graphes et celui dédié à Minimax/Alpha‑Beta pour des instances de jeu. Fournissez un fichier d'entrée décrivant l'instance (format JSON ou plain text selon le README du support), lancez les tests en mode verbose pour tracer l'exploration, et utilisez les outils de profiling intégrés (par ex. cProfile) pour mesurer temps et mémoire. Si des options de benchmark sont disponibles, exécutez des séries d'instances pour obtenir des courbes de complexité et valider les heuristiques de recherche.

Outils et bibliothèques pour pratiquer l'IA

Bibliothèques recommandées : Scikit‑Learn pour méthodes classiques, TensorFlow et PyTorch pour réseaux et apprentissage profond, Hugging Face Transformers pour modèles pré‑entraînés, OpenAI Gym et Stable Baselines3 pour apprentissage par renforcement. Ces outils facilitent la reproduction des expériences, l'entraînement de réseaux de neurones profonds et l'évaluation comparée des algorithmes.

IA Générative et LLM : Le lien avec l'IA classique

Intégrer les approches classiques et les modèles génératifs permet de tirer parti de la logique formelle et des capacités statistiques des modèles modernes. Les architectures contemporaines s'appuient sur principes appris dans les réseaux pour adresser tâches de génération, compréhension et raisonnement approximatif.

❓ Foire Aux Questions (FAQ)

Comment Alpha‑Beta améliore-t-il Minimax ?

Alpha‑Beta maintient des bornes alpha et bêta permettant de couper des branches dominées sans les évaluer entièrement. Avec un ordre de coups efficace, l'algorithme réduit fortement le nombre de nœuds explorés, améliorant temps et mémoire lors de recherches adversariales profondes.

En quoi TD(λ) diffère-t-il du Q‑learning ?

TD(λ) combine apprentissage temporel et traces d'éligibilité pour propager récompenses le long d'une trajectoire ; Q‑learning estime hors‑politique la fonction Q(s,a). TD(λ) ajuste le compromis biais‑variance via λ, tandis que Q‑learning converge vers une politique optimale sous conditions d'exploration suffisante.

Limitations pratiques

- Minimax suppose information parfaite ; inadapté aux jeux à information imparfaite sans extensions.

- Complexité exponentielle en profondeur : exploration exhaustive prohibitive sans heuristiques efficaces.

- Ordonnancement des coups critique : un mauvais ordre réduit l'efficacité de l'élagage Alpha‑Beta.

- Incapacité à gérer l'incertitude probabiliste sans intégration d'approches stochastiques ou de modèles de croyance.

- Risques et biais algorithmiques : données d'entraînement biaisées peuvent produire décisions discriminantes ; la gouvernance des données et des métriques d'équité est nécessaire pour atténuer ces effets.

Éthique et gouvernance : la conception et le déploiement d'algorithmes nécessitent une évaluation systématique des biais, de la protection des données et de l'impact social. Les pratiques recommandées incluent audits de biais, jeux de données diversifiés, protocoles de validation externe et mécanismes d'explicabilité pour faciliter la responsabilité. La documentation experte des expériences et des benchmarks (par ex. algorithmes de recherche PDF utilisés pour reproduire tests) permet d'améliorer la transparence et la confiance des modèles.

Développement des SMA et intelligence collective

Les SMA sont présentés selon la distribution des tâches, la coordination et l'émergence de comportements collectifs. L'intelligence collective émerge lorsque des agents simples coopèrent pour résoudre des problèmes complexes. Les architectures étudiées incluent protocoles de négociation, strategies de répartition et mécanismes robustes face aux pannes partielles, souvent complétés par algorithmes stochastiques pour exploration et adaptation.

Méthodologie et exercices pratiques

Sections méthodologiques et séries d'exercices corrigés IA accompagnent les développements théoriques pour faciliter l'acquisition opérationnelle. Chaque chapitre propose protocoles expérimentaux, jeux de données de référence et consignes reproductibles pour évaluer algorithmes et heuristiques. Les travaux pratiques couvrent implémentations en Python/Lisp, analyses de complexité, profiling et interprétabilité des modèles, avec études de cas ciblées sur la logique du premier ordre et les réseaux de neurones profonds.

Exercices corrigés en Intelligence Artificielle

Le cours contient une série d'exercices corrigés destinés à consolider la compréhension théorique par la pratique. Les fiches d'exercices détaillent les objectifs pédagogiques, les jeux de données simplifiés, les consignes d'implémentation et les critères d'évaluation. Ces ressources sont fournies pour permettre des sessions lab guidées et l'auto-apprentissage, et sont référencées pour une réutilisation dans des supports comme des exercices corrigés IA PDF et pour la préparation d'examens ou de projets.

- Calcul d'heuristique pour A* et évaluation empirique de l'admissibilité

- Implémentation et trace de la rétropropagation manuelle sur un réseau multi‑couche

- Profiling d'algorithmes de recherche : mesure temps/mémoire et optimisation

- Exercices sur TD(λ) et Q‑learning avec environnements OpenAI Gym

- Études de cas : construction d'un système expert simple et gestion des conflits de règles

Comparatif des outils : PyTorch vs TensorFlow

PyTorch privilégie une approche impérative et une expérimentation interactive, facilitant le prototypage et le débogage ; il est souvent préféré pour la recherche académique et les implémentations rapides. TensorFlow offre un écosystème large et des optimisations pour la production à grande échelle, avec Keras pour une API haut niveau. Le choix dépend des contraintes de développement, des besoins en déploiement et des préférences pour l'écosystème (outils de monitoring, intégrations cloud, support TPU/GPU).