Cours d'Utilisations des LLMs en PDF (Intermédiaire)

Utilisations des LLMs : Ce qu'il faut savoir. Les modèles de langage de grande taille (LLMs) animent l'IA générative et permettent de produire et d'interpréter du texte à grande échelle, transformant les interactions avec les outils numériques. Ce support est idéal pour ceux qui cherchent à télécharger un cours PDF complet sur l'intégration des LLM en entreprise.

Maîtriser l'IA Générative et les LLMs

- Introduction aux LLMs : Comprendre les bases des modèles de langage et leur fonctionnement.

- Applications pratiques : Explorer les diverses utilisations dans l'industrie, l'éducation et la recherche.

- Impact sur l'éducation : Analyser les effets sur les méthodes d'enseignement et d'apprentissage.

- Défis éthiques : Identifier les risques liés au biais, à la confidentialité et à la consommation énergétique.

Objectifs pédagogiques

- Comprendre les Transformers

- Maîtriser le prompt engineering

- Évaluer les risques éthiques

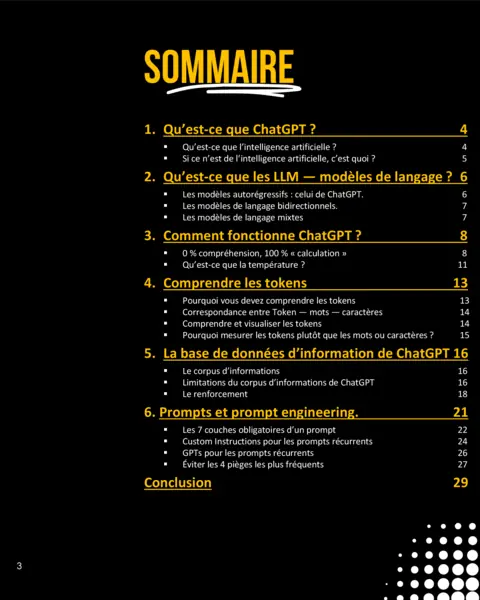

Sommaire du document

- Cours d'Utilisations des LLMs en PDF (Intermédiaire)

Fonctionnement de l'IA générative et apprentissage automatique

L'architecture Transformer et l'attention

L'architecture Transformer constitue la base des LLMs modernes : elle s'appuie sur le mécanisme d'attention pour mettre en relation des mots sur de longues séquences, et se déploie en plusieurs couches empilées optimisées lors d'un pré-entraînement sur de grands corpus. Après ce pré-entraînement, des étapes de fine-tuning ou d'ajustement supervisé permettent d'adapter le modèle à des tâches spécifiques. Ces principes relèvent de l'apprentissage automatique et expliquent la capacité des modèles à généraliser.

Limites et risques techniques

- Hallucinations IA : production d'informations non factuelles ou inventées par le modèle ; nécessite des stratégies de contrôle et de validation.

- Biais de données : les représentations apprises reflètent les biais présents dans les corpus d'entraînement, d'où la nécessité d'audits et d'une sélection raisonnée des jeux de données.

- Fenêtre de contexte : la capacité à prendre en compte l'historique est limitée par la taille de la fenêtre de contexte, ce qui impacte la gestion des conversations longues et des documents volumineux.

Pour une mise en production responsable, combiner audits, pipelines de validation automatisés et ajustement supervisé réduit les comportements indésirables et améliore la robustesse des systèmes.

L'évolution vers l'IA multimodale

Multimodalité : Texte, Image et Son

Les modèles évoluent vers des architectures multimodales capables de traiter et de fusionner des entrées textuelles, visuelles et audio. Ils supportent des données en entrée et en sortie variées : texte→image (génération d'illustrations à partir d'instructions), image→texte (légendes ou extractions d'information), audio→texte (transcription) et combinaisons mixtes pour des tâches complexes. Cette couverture facilite la compréhension d'images avec contexte textuel, la génération de descriptions audio et l'extraction d'information depuis des documents scannés.

Sur le plan technique, les embeddings multimodaux projettent différentes modalités (texte, image, audio) dans un espace vectoriel commun afin de mesurer la similarité entre éléments hétérogènes. Cette représentation partagée permet d'effectuer des recherches et des appariements cross-modaux (par exemple retrouver une image à partir d'une requête textuelle) et d'alimenter des index vectoriels pour la récupération d'information pertinente.

Applications et Cas d'Usage

Les LLMs servent à automatiser des tâches variées ; le prompt engineering améliore nettement les résultats pratiques en structurant le contexte, fournissant des exemples et définissant un format de sortie exploitable.

Prompt Engineering — L'art de formuler des instructions

Techniques clés : structurer le contexte, fournir des exemples (few-shot), définir un format de sortie et contraindre le style. Ces méthodes réduisent les hallucinations et orientent les modèles de fondation vers des réponses exploitables. Elles s'appliquent également aux scénarios multimodaux et se complètent par le fine-tuning pour des besoins métiers.

- Rédaction et création de contenu : synthèses, articles, guides et communications.

- Génération et assistance au code : exemples, complétions et revue de snippets.

- Analyse de données et extraction : résumé de rapports, classification et transformation de textes.

- Support client automatisé : résumés, réponses suggérées et routage.

- Marketing personnalisé : contenus adaptés à grande échelle et meilleure conversion.

| Cas d'usage | Bénéfices attendus | Exemple d'outil |

|---|---|---|

| Support client | Réponses plus rapides et standardisées, réduction des délais de traitement | RAG + ChatGPT / Claude |

| Marketing personnalisé | Contenus adaptés à grande échelle, meilleure conversion | Modèles de génération + pipelines personnalisés (Hugging Face) |

| Assistance au développement | Gain de productivité, accélération des revues et prototypages | Copilot / modèles open-source (Llama 3) |

| Extraction d'information | Structuration automatique des données, accélération des workflows documentaires | Outils d'indexation vectorielle (Milvus, FAISS) |

Architecture RAG et personnalisation des réponses

L'architecture RAG (Retrieval-Augmented Generation) combine un composant de recherche documentaire et un LLM pour enrichir la génération avec des passages pertinents issus d'une base de connaissances. En indexant vos documents et en effectuant une recherche (souvent vectorielle), le système fournit au modèle des extraits factuels qui réduisent les risques d'invention et améliorent la précision des réponses personnalisées. RAG facilite la personnalisation sans entraîner de nouveaux modèles de fondation lorsqu'il s'agit d'intégrer des connaissances propres à une organisation.

Le RAG : Augmenter les LLM avec vos données

Le RAG repose sur trois étapes : indexation des sources (documents, FAQ, bases internes), récupération des passages pertinents et génération conditionnée sur ces passages. Cette approche permet d'exploiter des données en entrée et en sortie spécifiques à votre contexte métier, d'actualiser les réponses sans réentraîner le modèle et d'améliorer la traçabilité des informations présentées.

Comparatif : Modèles Propriétaires vs Open-Source

Les modèles propriétaires proposent souvent des interfaces clé-en-main, des garanties de maintenance et des optimisations métier, mais peuvent impliquer des transferts de données vers des services externes. Les modèles open-source (par exemple Llama 3 ou Mistral) offrent la possibilité de déployer des instances locales ou sur cloud privé, réduisant l'exposition des données sensibles et facilitant la conformité. Llama et Mistral sont fréquemment choisis lorsqu'on recherche un compromis entre performance et contrôle, car ils permettent d'héberger les modèles au plus près des données et d'appliquer des politiques de sécurité strictes pour la confidentialité des données.

Cas d'usage par secteur d'activité

Juridique : analyse automatique de contrats, extraction de clauses, mise en évidence des risques contractuels et génération de résumés pour la due diligence. Les LLMs peuvent accélérer la recherche jurisprudentielle et la classification documentaire lorsqu'ils sont associés à des pipelines d'audit et de validation humaine.

Santé : aide à la synthèse de comptes rendus cliniques, extraction d'informations structurées et pré-triage de documents. Les déploiements en santé exigent des mesures strictes de pseudonymisation, des environnements isolés et des contrôles d'accès pour préserver la confidentialité des données patients.

Déploiement des LLM : Enjeux de souveraineté et sécurité

Le déploiement soulève des questions de souveraineté (hébergement local vs cloud public), de conformité réglementaire et de sécurité opérationnelle. Pour les organisations soucieuses de souveraineté, les options incluent le déploiement on-premise, l'utilisation de clouds locaux certifiés ou le chiffrement des indices vectoriels. Les bonnes pratiques recommandent l'audit des pipelines, la gestion fine des accès, la traçabilité des requêtes et l'utilisation de techniques de red-team pour détecter les vecteurs de fuite de données.

Vers une utilisation sobre et responsable de l'IA

La sobriété numérique impose de limiter l'usage des LLM aux tâches à forte valeur ajoutée et d'optimiser les architectures pour réduire l'empreinte carbone. Pratiques recommandées : privilégier des modèles plus légers lorsque la tâche le permet, utiliser la distillation, monitorer les indicateurs d'empreinte et réserver les modèles les plus gourmands aux cas où la valeur métier le justifie. L'intégration de RAG et d'indexations ciblées peut également réduire la nécessité d'appels coûteux en calcul en fournissant au modèle des passages pertinents plutôt que de solliciter des traitements massifs systématiques.

Impact environnemental

La consommation énergétique liée à l'entraînement et au déploiement des grands modèles reste un enjeu majeur. Mesures d'atténuation : choix d'infrastructures efficaces, optimisation des modèles, recours à des techniques de distillation et suivi des indicateurs d' empreinte carbone lors des mises en production.

À qui s'adresse ce cours ?

Public cible

Ingénieurs data, Product Managers et développeurs Python souhaitant approfondir l'utilisation des LLMs (niveau intermédiaire).

Prérequis

Connaissances de base en programmation ou en apprentissage automatique recommandées (niveau intermédiaire).

Défis éthiques et opérationnels

L'utilisation des LLMs soulève des enjeux de biais algorithmique, de protection des données, de transparence des modèles et de responsabilité en cas d'erreur. Il est essentiel d'appliquer des pratiques de validation, d'audit et de documentation pour limiter les risques et garantir la conformité réglementaire.

Foire Aux Questions (FAQ)

Qu'est-ce qu'un LLM ?

Un modèle de langage de grande taille (LLM) est un type d'intelligence artificielle conçu pour comprendre et générer du texte. Ils sont utilisés dans de nombreuses applications, de la rédaction automatique à l'assistance virtuelle.

Comment utiliser un LLM efficacement ?

L'utilisation optimale passe par le prompt engineering : fournir un contexte clair, des exemples (few-shot), définir le format de sortie et limiter la portée de la tâche améliore la pertinence des réponses. L'ajustement supervisé et le fine-tuning complètent ces approches pour des besoins métiers spécifiques, tandis que RAG permet d'ancrer les réponses sur des sources fiables. Pour des déploiements privés, préférer des modèles open-source (par ex. Llama 3, Mistral) ou des instances hébergées en local réduit le recours à des API externes.

Quelle est la différence entre un LLM et une IA générative classique ?

Les LLMs sont des modèles de fondation entraînés sur d'immenses corpus et optimisés pour des tâches linguistiques générales, tandis que l'IA générative "classique" peut désigner des modèles spécialisés (par exemple pour images ou audio) ou des architectures plus anciennes. Les LLMs se distinguent par leur capacité de transfert vers de nombreuses tâches et par l'usage de techniques comme le pré-entraînement massif suivi d'un ajustement supervisé.

Quels sont les outils recommandés pour pratiquer ?

Pour expérimenter : interfaces commerciales comme ChatGPT ou Claude offrent des environnements conviviaux ; des solutions open-source et des bibliothèques (par ex. modèles accessibles via Hugging Face, LLaMA / Llama 3, Mistral AI ou projets communautaires) permettent des déploiements locaux et des adaptations plus contrôlées. Pour implémenter des pipelines RAG, on trouve des outils d'indexation et de recherche vectorielle (FAISS, Milvus) complémentaires aux frameworks de modélisation.

Pourquoi télécharger ce support de cours ?

- Document de 62 pages signé Pierre Poulain, conçu pour un public intermédiaire souhaitant passer de la théorie aux cas pratiques.

- Regroupe principes fondamentaux (Transformers, attention), techniques opérationnelles (prompt engineering, ajustement supervisé, RAG) et enjeux (éthique, empreinte carbone).

- Approche pragmatique : cas d'usage en entreprise, tableau récapitulatif et recommandations pour un déploiement responsable.

- Contenu pertinent pour des projets intégrant IA générative multimodale et modèles de fondation.