Cours Compilation : Théorie des langages en PDF (Interm.)

Compilation — Théorie des langages : éléments essentiels. La compilation transforme un programme écrit dans un langage source en un langage cible exécutable ou intermédiaire par une suite de phases : analyse lexicale, analyse syntaxique, vérification sémantique, puis génération et optimisation du code. Le domaine formalise les langages à l'aide de grammaires, d'automates et d'attributs, et fournit des méthodes pour construire des analyseurs (lexers/parsers), des tables LL(1), des spécifications Bison ainsi que des optimisations telles que l'élimination des sous-expressions communes et l'interprétation abstraite. Le PDF rassemble ces éléments théoriques et pratiques et propose des supports pour la mise en œuvre avec Flex et Yacc/Bison.

🎯 Apprendre la théorie des langages formels et la compilation

-

Phases et architecture d'un compilateur

Identification des phases d'analyse (lexicale, syntaxique, sémantique) et de production (génération, optimisation) avec les rôles de la table des symboles et de la gestion d'erreurs ; organisation d'un pipeline de compilation et justification du placement d'analyses ou d'optimisations selon les propriétés du langage cible.

-

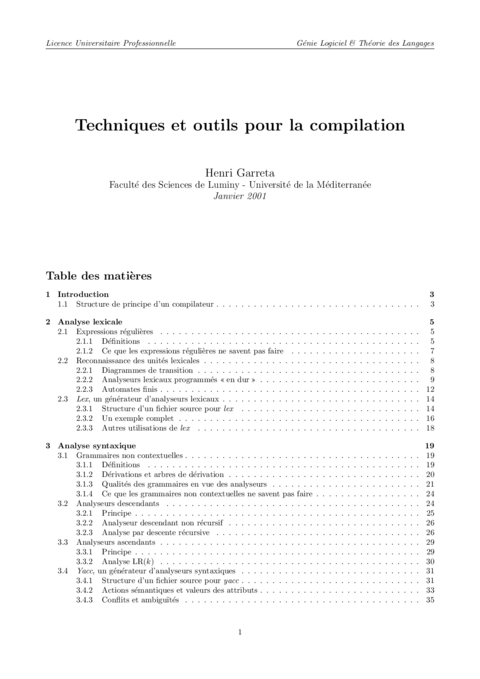

Analyse lexicale et expressions régulières

Formalisation des unités lexicales (lexèmes) et écriture d'expressions régulières robustes; spécification d'un fichier

.lpour Flex/lex et production d'un analyseur lexical traitant attributs et erreurs lexicales. -

Analyse syntaxique descendante et ascendante

Construction d'arbres de dérivation, tables LL(1), élimination de la récursivité à gauche et factorisation, ainsi que notions d'analyse ascendante et conflits shift‑reduce ; transformation d'une grammaire ambiguë en une forme adaptée à un parseur et comparaison des stratégies LL(1) vs LR. Les automates à pile sont présentés pour traiter les grammaires hors-contexte et illustrés par des exemples concrets d'analyse.

-

Outils pratiques : Yacc/Bison

Structure des fichiers de spécification, communication lexer/parser (ex:

yylval), attributs et actions en C, et gestion des conflits via associativité et priorité ; des exemples de fichiers.let.yinclus montrent des cas concrets à répliquer et adapter. -

Théorie des langages formels et automates

Classification des grammaires, construction d'automates finis à partir d'expressions régulières, déterminisation et minimisation d'automates, ainsi que notions d'automates à piles ; traduction d'expressions régulières en automates et application d'algorithmes de minimisation pour optimiser la reconnaissance lexico-syntaxique.

-

Génération et optimisation de code

Organisation de la mémoire d'exécution (pile/tas), production de code intermédiaire en trois adresses, construction du graphe de flot de contrôle et optimisations machine-indépendantes (propagation de copies, élimination d'expressions communes) ainsi que techniques avancées comme l'interprétation abstraite ; capacité à produire et améliorer un backend simple pour une machine cible donnée.

📑 Sommaire du document

Progression pédagogique : le cursus débute par les concepts formels (alphabets, mots, grammaires), enchaîne sur la construction d'un compilateur (lexing, parsing, sémantique), puis présente les outils pratiques (Flex, Bison) et les techniques d'optimisation. Chaque chapitre propose des exercices guidés et des travaux pratiques pour consolider l'implémentation des analyseurs et la génération de code.

Concepts fondamentaux des langages formels

Définition des langages formels

Un alphabet est un ensemble fini de symboles ; un mot est une suite finie de symboles sur cet alphabet. Un langage formel est un ensemble (fini ou infini) de mots sur un alphabet donné. Un langage L sur un alphabet Σ est un sous-ensemble du monoïde libre Σ*.

Classification de Chomsky

Les grammaires se répartissent selon la hiérarchie de Chomsky : type 0 (grammaires non restreintes), type 1 (grammaires sensibles au contexte), type 2 (grammaires hors-contexte, dites algébriques) et type 3 (grammaires régulières). Ce classement guide le choix des automates et des outils d'analyse adaptés à chaque famille de langages.

Méthodologie des Travaux Pratiques (TP) en compilation

Les TP suivent une progression du simple au complexe : création d'analysers lexicaux à partir d'expressions régulières, construction de grammaires non ambigües puis adaptation pour des parseurs LL(1) ou LR, implémentation d'un pipeline lexer→parser→backend, et application d'optimisations locales. Chaque séance inclut des objectifs mesurables, jeux de tests, et corrections commentées pour faciliter l'autoévaluation et la reproductibilité des expériences.

Théorie des automates et reconnaissance de langages

Les automates finis (AFN et AFD) servent à reconnaître les langages réguliers. La transformation d'un automate fini non déterministe (AFN) en automate fini déterministe (AFD) s'effectue par l'algorithme de déterminisation par ensembles d'états, suivi d'une minimisation pour réduire le nombre d'états. Ces techniques permettent de produire des scanners efficaces et prédictibles. Le cours présente la construction formelle des automates, la déterminisation, la minimisation et des propositions d'implémentation pour intégrer des automates finis déterministes dans une chaîne de traitement lexicographique.

Exercices corrigés : de la grammaire à l'analyseur syntaxique

Les séances de Travaux Pratiques incluent des exercices corrigés visant l'acquisition de compétences opérationnelles : rédaction de fichiers .l et .y, résolution de conflits, construction de grammaires hors-contexte et implémentation d'automates. Les TP guidés couvrent explicitement la gestion des erreurs syntaxiques (stratégies de récupération, messages d'erreur informatifs, tests de robustesse) et proposent des ateliers pour construire un analyseur LALR et vérifier sa résilience face à des entrées mal formées. Mots-clés inclus naturellement pour usage pédagogique : automates finis déterministes, grammaires algébriques, exercices corrigés compilation pdf, analyseur LALR.

Télécharger le cours Compilation et Langages PDF

Consulter ou télécharger le support depuis le site de l'Universite de Bretagne Occidental permet d'accéder aux 78 pages du document, aux exemples fournis et aux séances de TP. Le fichier regroupe les spécifications, énoncés corrigés et exemples de code pour une exploitation en autonomie ou en enseignement encadré.

💡 Pourquoi choisir ce cours ?

Produit par l'Universite de Bretagne Occidental, ce support combine exemples pratiques (utilisation de yylval) et formalisation théorique (grammaires, automates, attributs). L'approche pédagogique alterne démonstrations algorithmiques et exercices applicatifs pour faciliter le passage de la théorie à l'implémentation. Le contenu est conçu pour être exploitable en travaux pratiques et en projet de semestre.

👤 À qui s'adresse ce cours ?

- Public cible : étudiants en informatique (IUP/LICENCE), développeurs systèmes et ingénieurs logiciels souhaitant comprendre ou implémenter des analyseurs, des générateurs de code ou des optimisations sur des langages de programmation.

- Prérequis : bases en algorithmique et structures de données, notions de théorie des ensembles et expressions régulières, maîtrise d'un langage impératif (idéalement C) et familiarité avec la ligne de commande pour exploiter Flex et Yacc/Bison.

❓ Foire Aux Questions (FAQ)

Question : Qu'est-ce que Flex ?

Réponse : Flex est un générateur d'analyseurs lexicaux libre et moderne compatible avec la syntaxe traditionnelle de lex, optimisé pour la performance et la génération de scanners modulaires.

Question : Qu'est-ce que Bison ?

Réponse : Bison est un générateur d'analyseurs syntaxiques de type LALR(1) maintenu par le projet GNU, souvent utilisé en conjonction avec Flex pour construire des compilateurs et des analyseurs syntaxiques robustes.

Question : Qu'est-ce que Lex ?

Réponse : Lex est l'outil historique pour la génération d'analyseurs lexicaux; Flex en est une implémentation libre et plus performante dans de nombreux cas.

Question : Qu'est-ce que Yacc ?

Réponse : Yacc est l'outil originel pour la génération d'analyseurs syntaxiques ; Bison propose une compatibilité étendue et des fonctionnalités supplémentaires tout en conservant un usage similaire.

Question : Comment résoudre un conflit shift‑reduce dans un fichier Bison ?

Réponse : L'utilisation d'associativité et de priorité (%left, %right) règle souvent les conflits courants. Pour une solution durable, refactoriser la grammaire pour éliminer l'ambiguïté ou la reformuler en une forme non ambiguë reste préférable.

Question : Quand recourir à l'interprétation abstraite en optimisation ?

Réponse : L'interprétation abstraite sert à inférer des propriétés globales (par ex. invariants de boucle, plages de valeurs) sans exécution concrète ; elle s'applique pour des optimisations sûres comme l'élimination de calculs invariants et la détection d'expressions communes dans le graphe de flot.