Parallélisme et Distribution - Maîtriser les Concepts Clés

Télécharger cours gratuit sur Parallélisme et Distribution, une idée de la programmation, algorithmique sémantique de systèmes Parallélisme et Distribution, PDF tutoriel en 147 pages.

Ce cours sur le Parallélisme et la Distribution offre une introduction complète aux concepts fondamentaux et aux techniques avancées de programmation parallèle et distribuée. Il couvre les principes de base des threads Java, les modèles théoriques comme PRAM, ainsi que les mécanismes de coordination et d'exclusion mutuelle en mémoire partagée. Les problèmes d'ordonnancement, les protocoles de communication, le routage et l'invocation distante (RMI) sont également abordés pour une compréhension approfondie des systèmes distribués. Ce PDF de 147 pages explore également des applications pratiques, notamment en algèbre linéaire parallèle, et aborde les défis des systèmes tolérants aux pannes. Destiné aux étudiants et professionnels en informatique, ce tutoriel fournit des bases solides en algorithmique sémantique des systèmes parallèles et distribués. Les exemples et exercices proposés permettent de maîtriser la conception et l'optimisation d'algorithmes efficaces dans des environnements multi-processeurs ou réseaux distribués. Idéal pour ceux qui cherchent à approfondir leurs connaissances en programmation concurrente, ce cours combine théorie et pratique pour une approche équilibrée des défis modernes en calcul haute performance et en répartition de charge.

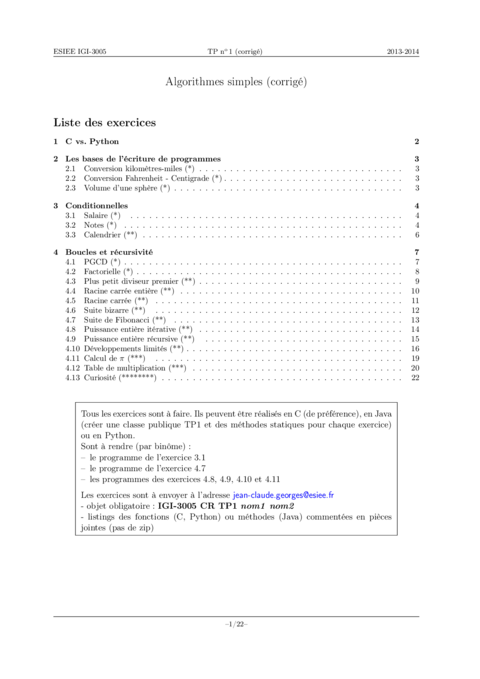

Contenus explorés en détail

Ce cours approfondit les concepts fondamentaux du parallélisme et de la distribution, en couvrant des sujets tels que la gestion des threads en Java, les modèles de calcul parallèle comme PRAM, et les mécanismes de coordination entre processus. Les algorithmes d'exclusion mutuelle et les problèmes d'ordonnancement sont également étudiés pour optimiser les performances dans des environnements multi-threads. Les communications distribuées, les méthodes d'invocation distante (RMI) et les systèmes tolérants aux pannes complètent cette formation, offrant une vision globale des défis et solutions en calcul parallèle et distribué.

- Maîtriser les techniques de parallélisation avec Java Threads et RMI.

- Comprendre les algorithmes de synchronisation et de tolérance aux pannes.

Public concerné par ce PDF

Ce cours s'adresse aux étudiants en informatique avancée, aux ingénieurs logiciels et aux développeurs souhaitant approfondir leurs connaissances en systèmes parallèles et distribués. Les professionnels travaillant sur des applications haute performance, des systèmes embarqués ou des architectures cloud trouveront également ce contenu pertinent pour optimiser leurs solutions.

Exemples pratiques et applications réelles

Les connaissances acquises sont appliquées dans des scénarios concrets comme le traitement massif de données (Big Data) avec Hadoop, la simulation scientifique distribuée, ou les systèmes transactionnels bancaires. Par exemple, les algorithmes d'exclusion mutuelle sont cruciaux pour éviter les conflits dans les bases de données répliquées, tandis que RMI est utilisé pour les microservices dans les architectures cloud modernes.

Secteurs d'application professionnelle

- Finance : Les systèmes distribués permettent des transactions haute fréquence avec une latence minimale, comme dans les plateformes de trading algorithmique.

- Santé : Le parallélisme accélère l'analyse génomique et le traitement d'images médicales, par exemple avec des frameworks comme Apache Spark.

- Jeux vidéo : Les moteurs multijoueurs utilisent des architectures distribuées pour synchroniser des milliers de joueurs en temps réel.

Guide des termes importants

- PRAM : Modèle théorique de machine parallèle à mémoire partagée, utilisé pour analyser la complexité des algorithmes.

- Exclusion mutuelle : Mécanisme empêchant deux threads d'accéder simultanément à une ressource critique.

- RMI : Remote Method Invocation, protocole Java pour l'appel de méthodes entre machines distantes.

- Load Balancing : Répartition de charge optimale entre nœuds dans un système distribué.

- Checkpointing : Sauvegarde périodique de l'état d'un système pour tolérance aux pannes.

Réponses aux questions fréquentes

Quelle est la différence entre parallélisme et distribution ?

Le parallélisme exploite plusieurs cœurs/threads sur une même machine, tandis que la distribution relie plusieurs machines via un réseau, avec des défis supplémentaires comme la latence.

Pourquoi utiliser Java RMI plutôt que REST ?

RMI offre une intégration transparente avec Java (sérialisation d'objets), mais REST est plus flexible pour les systèmes hétérogènes.

Comment éviter les deadlocks en mémoire partagée ?

En utilisant des algorithmes comme l'attente circulaire ou des timeouts, et en ordonnant les requêtes de ressources.

Quels langages sont adaptés au calcul parallèle ?

Java, C++ (avec OpenMP), et Go sont populaires, mais des langages comme Erlang excellent pour la distribution.

Qu'est-ce qu'un système tolérant aux pannes ?

Un système conçu pour continuer à fonctionner malgré des défaillances partielles, via la réplication ou le checkpointing.

Exercices appliqués et études de cas

Projet 1 : Implémentez un système de vote distribué avec RMI. Étapes : 1) Définir l'interface des services, 2) Gérer la synchronisation des votes, 3) Ajouter une logique de reprise sur panne.

Projet 2 : Simulez un algorithme d'exclusion mutuelle (ex. Peterson) avec des threads Java. Mesurez les performances avec/sans contention.

Étude de cas : Analysez l'architecture de Cassandra (base de données distribuée) et son modèle de cohérence eventual consistency.

Lien sécurisé · gratuit · aucune inscription requise